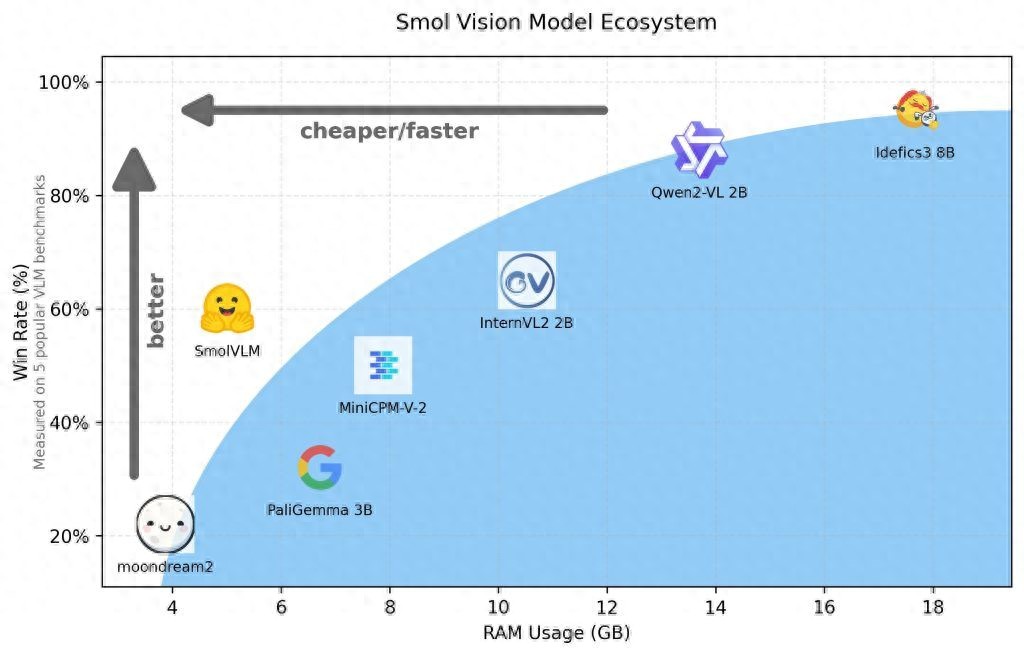

在科技飞速发展的今天,人工智能技术不断进步。最近,Face平台推出的AI视觉语言模型备受瞩目。这款模型参数仅有20亿,与众不同的它在众多同类模型中脱颖而出,虽体型小巧,但功能十分出色。在以大型模型为主的市场中,这样的小型模型犹如一股清泉,让人眼前一亮。

AI模型的发布与开源

发布这个AI视觉语言模型确实挺不容易的。Face平台在11月26日通过博客公告了这个消息。这个模型的一个显著优势是它的完全开源。11月27日,消息一出,大家便开始关注它的方方面面。这种开源模式对整个行业都是有益的。其他开发者可以基于这个基础进行深入研究。无论是模型的检查点还是数据集,都可以被用于进一步的开发工作。

这种开源方式与科技领域推崇的共享创新理念相契合。正如众多成功的开源项目那样,众多人士得以加入其中。无论身处何地,专家们均可研究这一模型,此举亦能推动各地科技间的交流,普遍受到大家的喜爱。

三个不同版本的AI模型

该AI模型包含三个版本,即-Base、-和-。其中,-Base版主要适用于后续的微调工作。它能够根据具体需求进行定制化修改,从而更好地适应各种应用环境。例如,在特定工业领域,我们可以根据实际数据进行调整,以优化-Base版本的性能。

该版本是通过合成数据进行的精细调整。与之相对的是指令微调版本,它可直接应用于互动场景。这就像提供了一款现成的操作工具,无论是手机还是智能设备上,都能直接使用。不同的版本针对不同的使用需求。

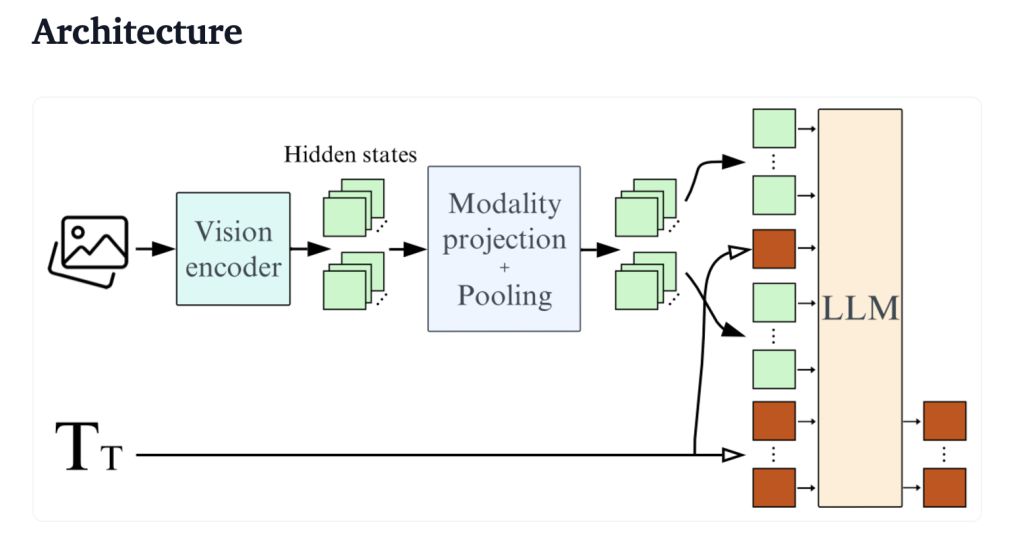

架构的独特之处

该模型最显著的特点是其架构设计的精巧。它参考了某些元素,并选用了1.7B作为语言的核心。在视觉信息处理领域,这一点尤为突出。模型运用了像素混洗技术,将视觉信息的压缩比提升至9倍。这一成就显而易见,表明它能够显著减少所需空间并加快处理速度。

它的训练数据涵盖了多个方面,并对相关内容进行了拓展。这使模型具备了处理更长的文本和图像序列的能力。从开发初期到如今成果的发布,尽管开发地点未公开,但这一技术成果具有全球影响力。它克服了大型模型以往的问题,对设备性能的提升起到了显著作用。

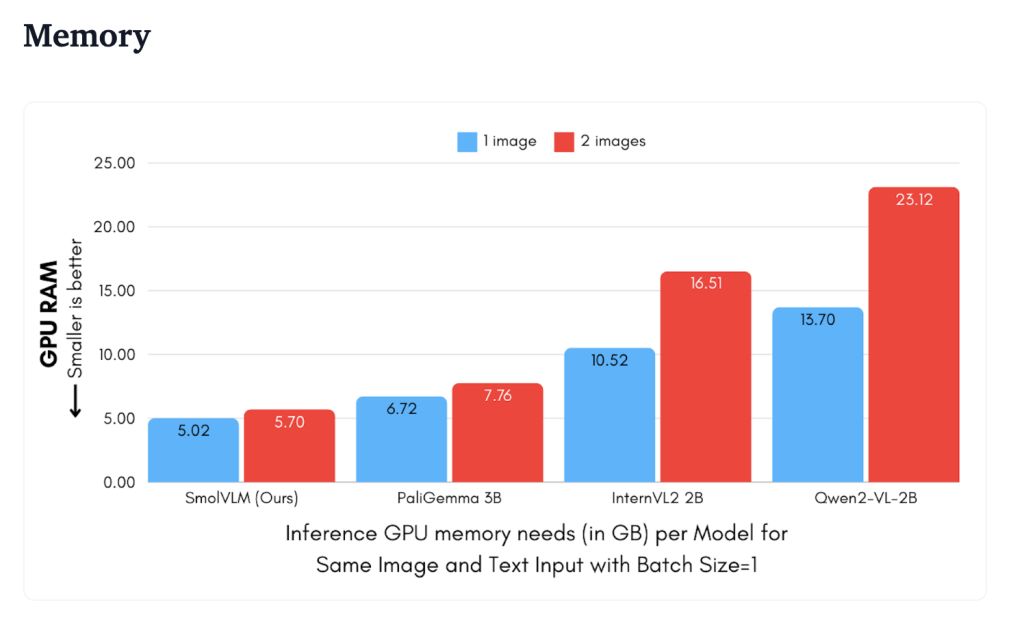

内存占用的优势

这个模型在内存使用上表现优异。它将图像块压缩成81个,而同类测试中,它只用了1200个,Qwen2-VL则需1.6万个。这种显著差异彰显了模型在内存利用上的高效性。无论是小型智能设备还是普通电脑,低内存占用都能使设备运行更流畅,处理应用和任务更加顺畅。对用户而言,这意味着更快的结果获取和更佳的体验。

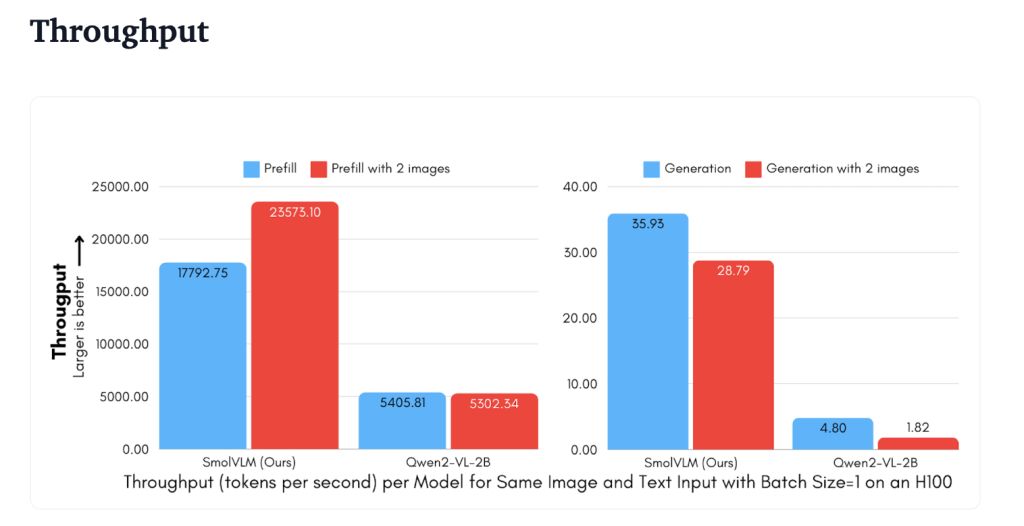

吞吐量测试表现

该模型在多个测试中表现出色。比如在MMMU等多个测试中都获得了不错的成绩。尤其是与Qwen2-VL相比,其预填充吞吐量快了3.3到4.5倍,生成吞吐量更是快了7.5到16倍。这些数据充分说明了该模型处理速度之快。无论是处理大量数据还是迅速响应交互请求,它都能显现出其独特优势。

模型的影响与前景

AI视觉语言模型的问世对行业带来了一定程度的变化。模型体积小巧,使得众多普通设备也能运行高端AI服务。这尤其在发展中国家或科技资源相对匮乏的地区显得尤为明显,那里的设备也能借助该模型享受到AI技术的成果。那么,这样的小型高效AI模型将如何影响我们日常使用小型设备的体验?欢迎点赞、转发,并在评论区展开讨论。