字节跳动对田某某实习生涉嫌修改代码和攻击公司模型训练系统一事,已向法院提起法律诉讼。目前,案件正在法院审理之中,其中涉及诸多引人注目的细节。从网络传播带来的巨大经济损失,到字节跳动官方的回应,这一事件引发了众多疑问和深刻的思考。

事件缘起

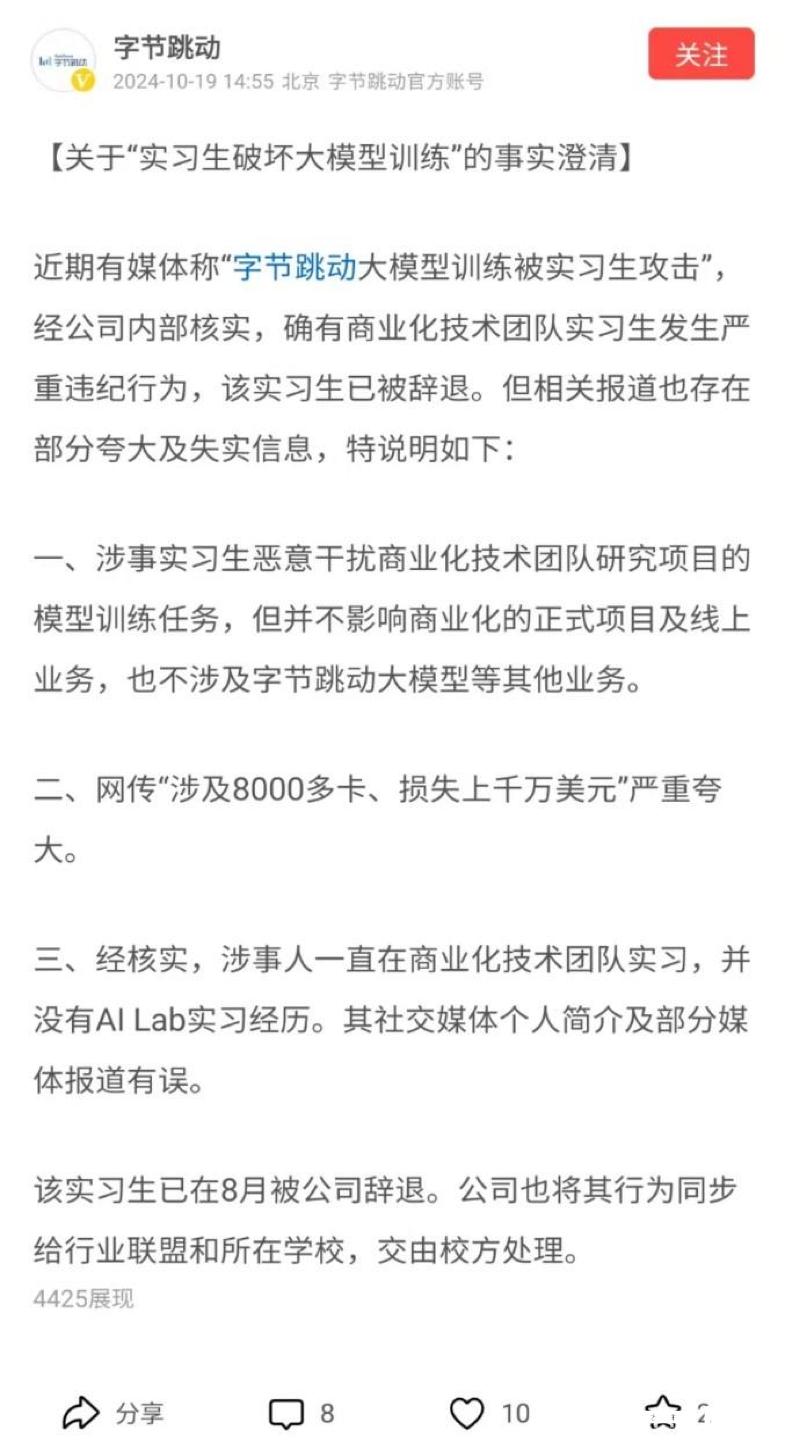

2024年10月,字节跳动的大模型训练任务遭遇了实习生的不当干预,这一消息很快传遍了开来,引起了众人的极大关注。据悉,此事涉及到了超过8000张显卡,造成的损失达到了千万美元级别,这个数字确实令人震惊。消息的传播速度之快,让人不禁感到意外。紧接着,字节跳动公司对此作出了回应,确认实习生故意干扰了模型训练任务,但他们同时也强调,这不会对公司的正式项目和线上业务造成影响,并且否认了开展与大模型相关业务的事实。

这不是首次发生类似情况。记得2020年二月,微盟的研发团队遭遇了恶意破坏事件,这一事件不仅让公司市值急剧缩水,还带来了不小的损失。从这个事件中,我们可以看出,一旦公司内部遭受攻击,其后果是相当严重的。

实习生反应

内部人士透露,田某某在处理此事时反复对外否认,断然否定攻击任务由他发起,坚称是他人所为。这种行为让问题愈发棘手。为何一名实习生会这么做?他是在试图掩饰自己的过失,还是真的无辜而竭力为自己辩解?目前尚不得而知。然而,这无疑给字节跳动处理此事增添了诸多困扰。

字节跳动内部问题

这一事件暴露出字节跳动在技术培训环节的安全管理存在漏洞,这些问题包括权限分配和代码审查等多个层面。对于科技公司来说,尤其是当业务延伸至大模型等关键领域时,加强安全管理显得尤为关键。培养大模型不仅成本高昂,技术挑战也极为严峻,一旦出现问题,影响将波及多个方面。字节跳动似乎之前并未充分意识到这些潜在的风险,迫切需要深入反思并采取相应的改进措施。

成本角度的看法

由于成本考量,网络安全方面的专家指出,在编写程序时,企业往往对员工抱有信任。若员工间彼此猜疑,企业可能因高额成本难以持续。这无疑是个棘手的问题。既要保障安全,又要在这两者间找到平衡。那么,字节跳动如何在信任员工的同时,减少内部不良行为的风险?这个问题确实值得深入研究。

大模型安全问题受关注

大型模型正迅速发展并广泛应用,但字节跳动近期遭遇的内部攻击事件,已将大模型的安全问题提升到了至关重要的地位。考虑到大模型在众多行业中的重要作用,一旦出现类似问题,企业可能会遭受严重损失,并且可能引发一系列不良后果,包括数据泄露和模型错误等。

字节跳动发展历程中的相关情况

豆包大模型在字节跳动表现出色,自5月15日推出以来,其价格低于市场同类产品,有效推动了大模型向价值创造阶段的发展。豆包模型吸引了大量月活跃用户,在国内AIGC应用领域非常活跃。此外,字节跳动近期发布了豆包视频生成功能的测试版,正式进入AI视频生成市场。面对这样的发展态势,字节跳动必须加强内部安全管理,防止类似事件干扰其宏伟目标的达成。

您觉得字节跳动在内部控制上,特别是在安全防护方面,需要实施哪些独特的策略?期待您能发表见解。若觉得这篇文章有参考价值,不妨点个赞或者转发一下。