我们常常通过视觉信息来评估事物的真实性。但AI制作的图片却扰乱了我们的判断。有些看起来很真实的图片可能是由AI生成的,这使得辨别真伪变得格外棘手,也给人们带来了不少麻烦。这正是我们目前遇到的一个严重问题。

AI图片真假难辨

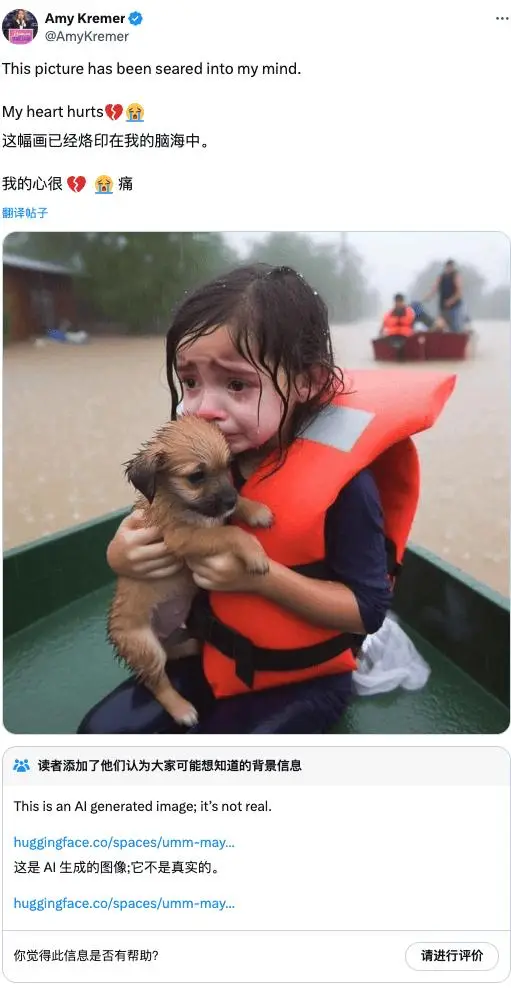

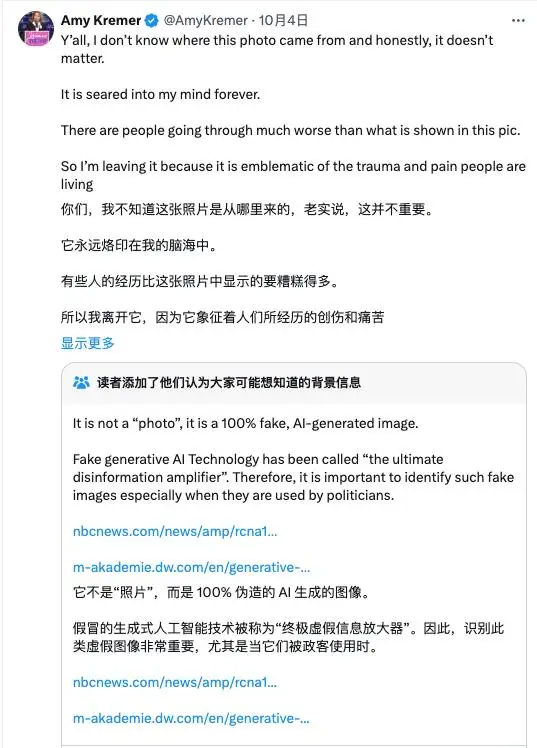

AI技术进步神速,所产出的图片几乎可以以假乱真。就拿那张图片来说,有人坚信那是真人拍摄的,而有人却认为那是AI制作。比如那幅引起争议的女孩救生衣图,细节上有些不寻常,但难以确切判断。这导致人们在判断信息来源时变得格外小心和怀疑。而且,不同人对图片的看法差异很大,这主要是因为每个人的人生经历和对AI技术的认知水平不同。

众多看似逼真的AI制图出现后,大家对所见的图片都产生了疑问。人们在面对可能由AI制作的图片时变得格外谨慎,不敢轻信自己的眼睛。这种现象不仅扰乱了民众的判断力,还干扰了社会信息的正常流通。

媒体博眼球现象

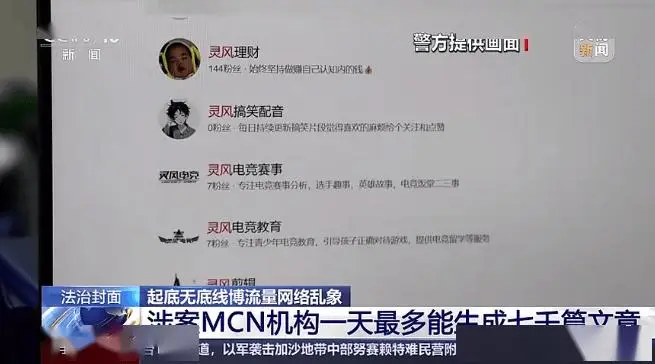

媒体为了追求点击率和热度,频繁以AI生成的图片为素材撰写报道。不少新闻报道附带的AI图像,容易误导公众。比如,关于六月西安爆炸事件的虚假信息,提供了具体的时间和地点,能在短时间内迅速传播大量信息。这种做法背后往往存在利益驱动。在Meta公司旗下的平台上,点赞数高的帖子可以获得高额的曝光奖励。这种现象使得虚假新闻日益增多,公众对媒体的信任度逐渐下降。

这种吸引眼球的做法让公众被虚假信息所环绕。经过多次受骗,人们对媒体发布的新闻产生了怀疑。若持续如此,真实新闻也可能被误认为虚假,媒体的信誉受到严重损害,这对社会信息的传播造成了极大的负面影响。

公众的怀疑精神

在这样的情境中,人们的质疑意识逐步增强。遇到图片时,他们起初持怀疑态度。比如,面对那张奇特的女孩照片,公众的疑问促使平台补充了相关信息。这种质疑态度具有正面价值,有助于避免大众被轻易误导。

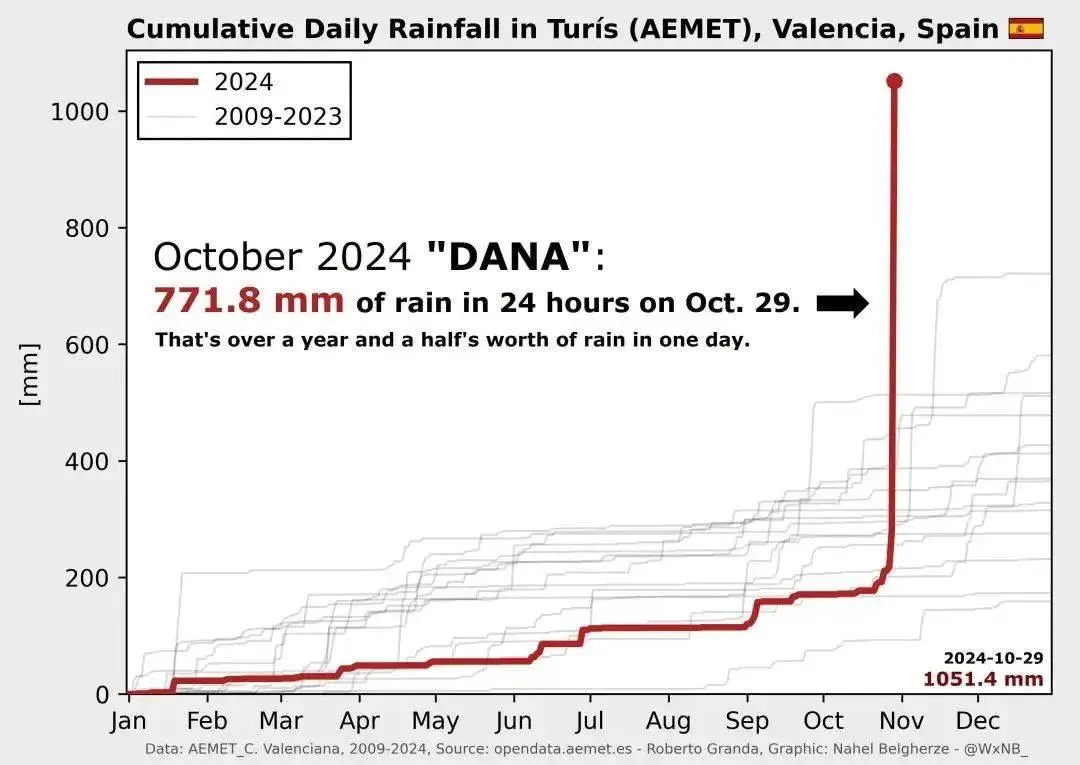

过度怀疑带来不少问题。一旦所有信息都先受到质疑,例如,真正的灾情报告可能被误认为AI生成的图片而遭忽视。真实信息被贴上虚假标签,导致需要帮助的人和事无法及时获得援助,这无疑极为危险。

对弱势群体的影响

AI生成的虚假图像对弱势群体造成了显著影响。工作人员在辨别AI制作的图像中是否含有虐待成分时感到困难。在遇到大量真假难辨的图片时,很容易错失救助儿童等弱势群体的良机。正如IWF的分析师所言,众多虚假图像可能会掩盖那些真正需要帮助的情况。

而且,弱势群体的利益在这种真伪难辨的情境下,可能会被忽略。若仅因假照片众多而做出全盘否定,那么那些真正遭受伤害的弱势群体,就可能无法获得应有的关注与保护,进而无法得到必要的援助。

产生狼来了的局面

由于AI假图片频繁冒充真实图片传播,导致局面如同狼来了的故事。人们受骗多次,现在对任何信息都持怀疑态度。他们见到不熟悉的图片,不论真假,首先就认为是AI制作的。

真正的危险信号因而被忽视。即便确实是警报,人们也不予信任。这种不信任不仅针对个别信息,更是对整个信息来源的信任丧失。这样的后果可能是无法挽回的。

信任的逐渐丧失

最初,人们坚信眼见为真,可如今,即便亲眼所见也不再可信。网络上,大众的信任感正慢慢减弱。过去,我们常凭借图片来判断事件的真实性,可如今,我们却不敢轻易相信。这种信任的缺失,影响的不仅是图片的真实性认知,更波及到对整个网络信息的信任度。

在网络世界中,我们怎样重拾信任?是依靠更精确的识别手段,还是制定新的信息评价准则?期待大家在评论区各抒己见。若觉得本文有借鉴意义,不妨点个赞或转发一下。