Sora文本转视频AI模型泄露事件如同重磅炸弹。此事不仅暴露了AI模型在安全管理上的漏洞,还揭示了背后复杂的利益纠葛和艺术家的不满情绪。此事关联多方利益,引发了人们的深思。

事件回顾

周二这天,Sora测试的接口出现了泄露。一些提前体验的艺术家将本应保密的信息公布在了Face平台上。在权限被关闭之前,大量AI视频被制作并流传开来。三个小时后,所有涉事艺术家的测试权限都被关闭了。实际上,这并非一个孤立的事件,它揭示了整个AI项目管理在信息保密方面的缺陷。在此过程中,管理方未能有效阻止信息泄露,同时也暴露了他们在应急处理方面的不足。

那些首先获得试用接口权限的艺术家们首当其冲。他们原本是项目选拔的对象,却不幸成了泄露事件的导火索。这一事件进而引发了一系列更严重的矛盾和冲突。

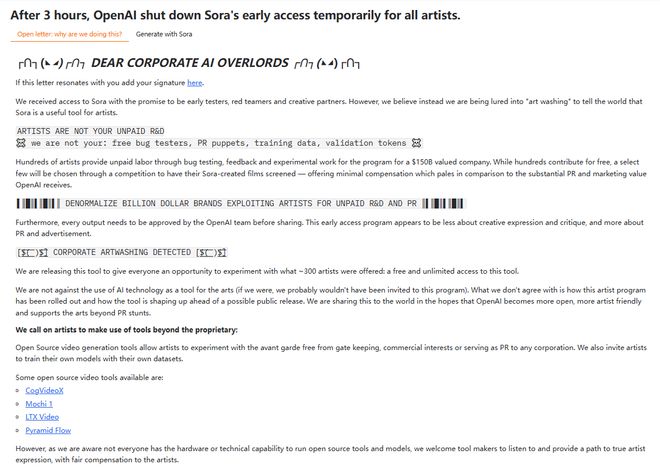

公开信原因

此次事件与艺术家们的怨言紧密相关。他们原本只是测试者等多重身份,却感到自己被利用了。OpenAI似乎打算借助他们,将Sora打造成为艺术家的得力助手,然而艺术家们却觉得自己成了免费的研发团队。数百名艺术家在市值高达1500亿美元的公司里无偿付出,从事漏洞测试等多项工作。

众多参与者中,仅有少数人能成功发布作品,得到的酬劳却很少。这种投入与收获的巨大差距,必然会引起艺术家们的不满和反抗情绪的加剧。

内容审批争议

艺术家们对Sora内容的审核规定表示强烈不满。这项规定要求在内容分享前必须经过批准。从艺术家的立场来看,这极大地限制了他们分享作品的自由。他们参与项目初衷就是为了创作,若作品不能及时展示,那么创作的价值似乎也就不复存在。

OpenAI可能采用了内容审查的策略,但这种过于严格的标准并未充分考虑艺术家们的需求,反而加剧了双方之间的冲突。

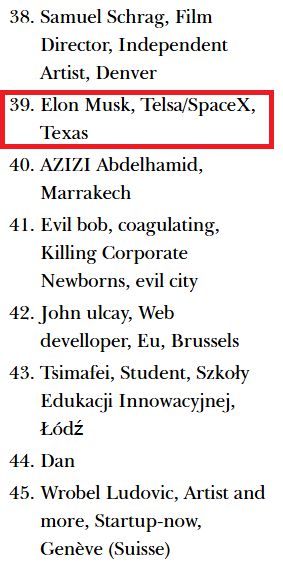

联名信与马斯克

网页上公开信的联名者共有122位,其中马斯克的名字格外显眼。尽管签名系统并不需要严格的身份验证,无法确定是否真是他本人,但他的名字出现本身就吸引了众多目光。名人的影响力让这件事的传播范围变得更广。

若马斯克确实赞同这一联名,那便表明他认为了解AI在此事上确有不当之处。若非他本人所为,这也反映出联名信的影响力已大到足以引发冒名顶替的情况。

行业反思

这一事件促使AI行业深入思考。在模型测试和推广方面,如何实现平衡。众多科技公司正积极推动AI项目,如何防止出现与测试者之间的冲突,避免测试者感到自己成了无偿的劳动力。

此外,模型的安全保密措施同样需要重新检查。只有每一个环节都严格把关,才能既保护自身权益,又能使合作双方都感到满意。

未来展望

OpenAI在接下来如何处理与这些艺术家的互动至关重要。它可能需要改善双方的合作方式,为艺术家争取更多权益,或者坚持己见。这一决策不仅会对Sora的未来走向产生重大影响,还将左右AI创作领域对OpenAI的整体看法。

在AI艺术创作这一新兴领域,构建一个更为公正合理的合作机制至关重要,它直接影响到这一领域的健康发展。关于Sora事件,它是否可能成为推动AI艺术创作合作模式变革的转折点?期待各位读者在评论区点赞分享,并发表自己的看法。